本文中含有需要您注意的重要提示信息,忽略该信息可能对您的业务造成影响,请务必仔细阅读。

接入云产品日志后,您可以使用热数据和冷数据存储方案对云产品已进行标准化的日志进行存储和查询,以便帮助您精准定位各类告警,并进行攻击溯源,提高对潜在安全威胁的响应速度,并降低多资源环境的日志管理难度,从而加强整体安全防御体系。本文介绍如何使用热数据和冷数据这两种存储方案。

功能原理

热数据

热数据是威胁分析与响应服务联合日志服务SLS提供的多云、多账号和多产品的日志集中存储和分析能力。

购买威胁分析与响应后,威胁分析与响应服务会在日志服务自动创建一个专属Project(命名为aliyun-cloudsiem-data-阿里云账号ID-RegionID)和专属Logstore(命名为cloud_siem),用于存储威胁分析与响应收集到的所有日志数据。威胁分析与响应日志的存储地域取决于您在云安全中心控制台左上角选择的服务所在区域。

选择中国时,威胁分析与响应收集到的日志将存储在华东2(上海)地域。

选择全球(不含中国)时,威胁分析与响应收集到的日志将存储在新加坡地域。

当您开启对应日志类型的热数据投递任务后,威胁分析与响应服务会自动将日志投递到日志库cloud_siem中。投递的日志会一直保留,直到超过您设置的存储天数后,对应日志数据被删除。如果日志存储空间耗尽,新日志会停止投递。在已使用的日志容量超过总容量的80%时,云安全中心支持发送通知信息。通知设置的具体操作,请参见通知设置。

冷数据

冷数据是基于阿里云自研的安全数据湖能力,联合OSS提供的日志存储及数据湖构建服务提供的日志分析能力。

开通冷数据功能后,威胁分析与响应服务会在OSS服务创建两个Bucket:

security-lake-阿里云账号ID-数据湖名称:该Bucket存储投递到冷数据中的日志数据。日志数据会按照您设置的存储天数进行保存,超过存储天数的日志会被删除。

security-lake-阿里云账号ID-数据湖名称-query-result:该Bucekt存储日志查询的结果,该Bucket内的数据长期保存。您可以自行清理无需保存的历史数据。

Bucket的地域取决于您在云安全中心控制台左上角选择的服务所在区域。

选择中国时,Bucket将创建在华东2(上海)地域。

选择全球(不含中国)时,Bucket将创建在新加坡地域。

计费说明

热数据

包年包月预付费。按照您购买的日志分析存储容量和购买时长收取费用。您在云安全中心控制台进行日志查询、导出等操作时,不会产生其他费用。

热数据功能将日志投递到日志服务后,如果您在日志服务控制台对日志数据进行加工、投递等操作,您可能需要额外支付该部分费用。

当Logstore的计费模式为按使用功能计费时,在日志服务进行数据加工、投递、从外网接入点流式读取数据操作,由日志服务收取加工计算费用、数据投递费用和外网读取流量费用。更多信息,请参见按使用功能计费模式计费项。

当Logstore的计费模式为按写入数据量计费时,在日志服务进行数据加工、投递等操作免费,仅在日志服务进行外网数据读取时将按照日志服务标准方式收费。更多信息,请参见按写入数据量计费模式计费项。

冷数据(公测中)

按存储的OSS数据量,由OSS服务收取存储费用。更多信息,请参见计费概述。

查询数据时会使用数据湖构建的能力,可能会产生费用,对应费用由数据湖构建DLF服务收取。更多信息,请参见计费模式。

重要DLF产品目前所有功能为0折扣活动阶段,即使超过免费阶梯限定后,目前也均不会产生实际计费。

冷数据功能目前在公测中,不收取费用。公测结束后,会根据接入数据流量(GB)和数据标准化容量(GB)收取对应的费用。

如何选择热数据或冷数据存储

您可以同时使用热数据和冷数据功能,灵活地根据不同日志类型的应用场景,选择合适的数据投递存储类型。

数据投递存储类型 | 特征说明 | 应用场景 |

热存储 | 存储费用较高,查询效率高。 | 查询频率较高的日志,对查询实时性要求高的日志类型。例如告警日志。 |

冷存储 | 存储费用较低,查询效率低。 | 查询频率低,对查询速度没要求的日志类型。例如WAF流日志。 |

管理热数据

前提条件

步骤一:开启投递

登录云安全中心控制台。在控制台左上角,选择需防护资产所在的区域:中国或全球(不含中国)。

在左侧导航栏,选择。

在产品接入页面右上角,单击日志存储管理。

在日志投递管理区域,打开需要投递的日志类型投递到热数据/启停时间列下的开关。

您可以选中多个日志类型后,单击批量投递,并选择到热数据。

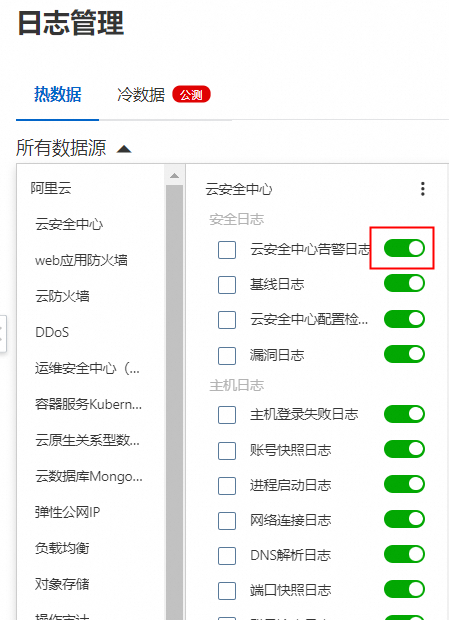

在日志管理页面,打开目标日志类型右侧的开关,也可以直接开启该日志到热数据的投递。

如果您不需要再存储某个类型的产品日志,您可以关闭该日志类型的投递开关。热数据将不会再接收该日志类型产生的新日志。

步骤二:查询日志

在左侧导航栏,选择。

在日志管理页面热数据页签左上角,单击所有数据源,在所有数据源下拉列表,选中需要查看的数据源(即选择云产品和日志类型)。

设置查询时间,通过查询语句检索日志,并查看日志分析数据。

威胁分析与响应的日志搜索功能和云安全中心日志分析查询方法相同,具体操作,请参见自定义日志查询与分析。

更多操作

修改日志存储天数

开启投递的云产品日志默认存储天数为180天,您可以根据需要修改存储天数。

在左侧导航栏,选择。

在产品接入页面右上角,单击日志存储管理。

在日志管理面板,修改热数据的存储天数。

日志存储容量管理

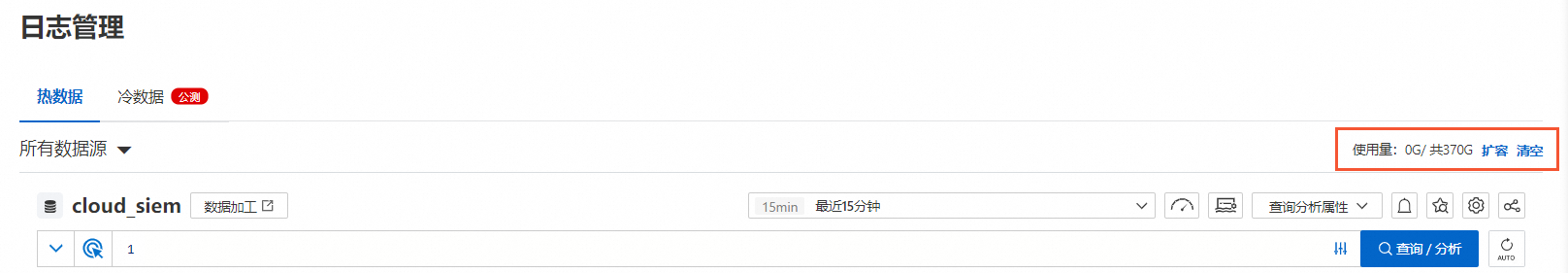

您可以在页面的热数据页签,查看当前的日志使用量和总容量。您可以按需扩容或清空日志存储空间。

单击扩容,可购买更多日志存储容量。

请确保日志存储空间充足。如果日志存储空间被占满,将无法写入新的日志。

单击清空,可清空存储空间。

警告清空存储空间后将无法复原日志数据,请务必谨慎使用清空功能。建议您先将日志导出并存储到本地后,再清空存储空间。

管理冷数据

前提条件

已开通对象存储OSS服务。更多信息,请参见步骤一:开通OSS服务。

步骤一:开通冷数据功能

开通冷数据功能时,需要完成服务关联角色授权,开通数据湖构建服务,并在OSS服务中创建Bucket。以下是具体的操作步骤:

登录云安全中心控制台。在控制台左上角,选择需防护资产所在的区域:中国或全球(不含中国)。

在左侧导航栏,选择。

在冷数据页签,单击立即开通。

在授权开通安全数据湖区域,单击开通授权。

在创建安全数据湖实例对话框,单击确定授权。

单击确定授权后,系统将自动创建服务关联角色AliyunServiceRoleForSasSecurityLake,允许冷数据功能访问您的对象存储OSS、数据湖构建DLF中的资源。更多信息,请参见云安全中心服务关联角色。

在免费开通数据湖构建区域,单击立即前往。

在数据湖构建控制台,单击免费开通数据湖构建,根据界面提示,单击立即开通,开通数据湖构建服务。

如果您已开通数据湖构建服务,请跳过当前步骤。

返回云安全中心控制台,在创建安全数据湖实例区域,单击立即创建。

在创建安全数据湖实例对话框,输入数据湖名称,单击确定。

威胁分析与响应服务会自动在OSS服务中创建名称为security-lake-阿里云账号ID-数据湖名称的实例。

步骤二:开启投递

登录云安全中心控制台。在控制台左上角,选择需防护资产所在的区域:中国或全球(不含中国)。

在左侧导航栏,选择。

在产品接入页面右上角,单击日志存储管理。

在日志投递管理区域,打开需要投递的日志类型投递到冷数据/启停时间列下的开关。

您可以选中多个日志类型后,单击批量投递,并选择到冷数据。

如果您不需要再存储某个类型的产品日志,您可以关闭该日志类型的投递开关。冷数据将不会再接收该日志类型产生的新日志。

步骤三:查询日志

在左侧导航栏,选择。

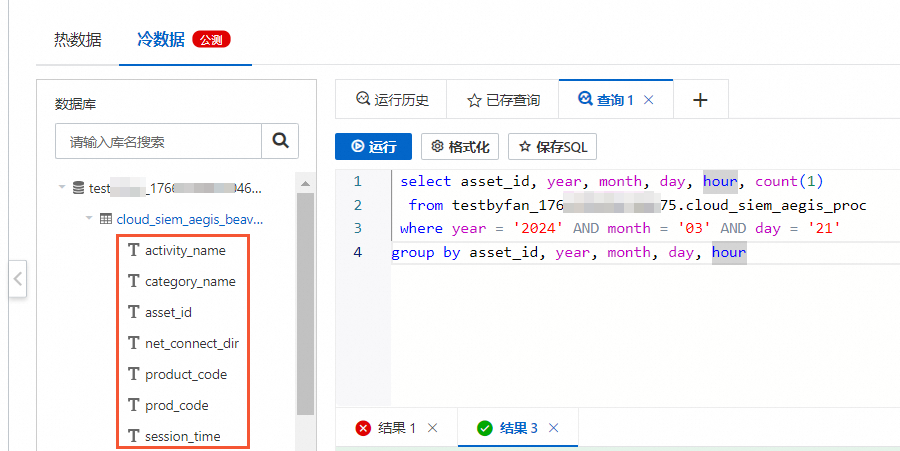

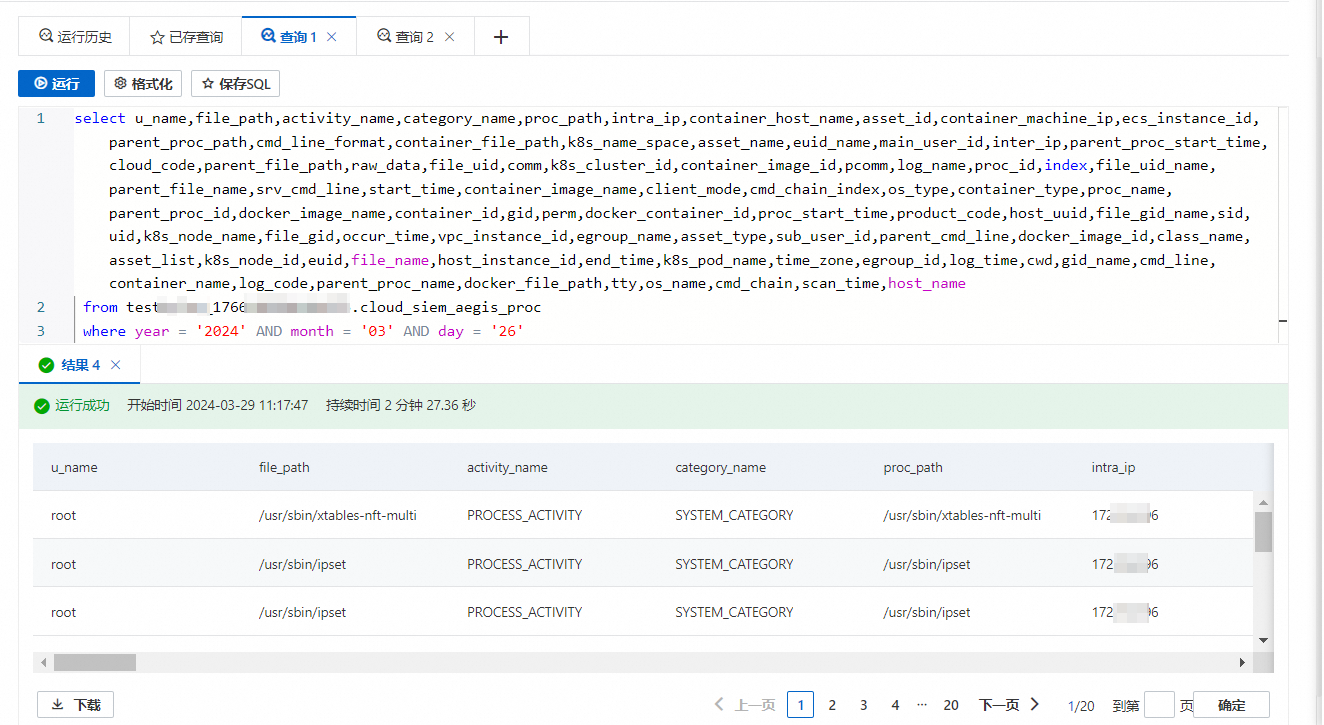

在冷数据页签,单击查询1,在SQL语句执行区域输入需要执行的SQL语句,单击运行。

在数据库左侧列表中可以查看支持查询的字段。

以下是查询使用的常见语句:

简单查询

select u_name,file_path,activity_name,category_name,proc_path,intra_ip,container_host_name,asset_id,container_machine_ip,ecs_instance_id,parent_proc_path,cmd_line_format,container_file_path,k8s_name_space,asset_name,euid_name,main_user_id,inter_ip,parent_proc_start_time,cloud_code,parent_file_path,raw_data,file_uid,comm,k8s_cluster_id,container_image_id,pcomm,log_name,proc_id,index,file_uid_name,parent_file_name,srv_cmd_line,start_time,container_image_name,client_mode,cmd_chain_index,os_type,container_type,proc_name,parent_proc_id,docker_image_name,container_id,gid,perm,docker_container_id,proc_start_time,product_code,host_uuid,file_gid_name,sid,uid,k8s_node_name,file_gid,occur_time,vpc_instance_id,egroup_name,asset_type,sub_user_id,parent_cmd_line,docker_image_id,class_name,asset_list,k8s_node_id,euid,file_name,host_instance_id,end_time,k8s_pod_name,time_zone,egroup_id,log_time,cwd,gid_name,cmd_line,container_name,log_code,parent_proc_name,docker_file_path,tty,os_name,cmd_chain,scan_time,host_name from test****_17661858941*****.cloud_siem_aegis_proc where year = '2024' AND month = '03' AND day = '26' limit 200查询结果如下:

统计分析

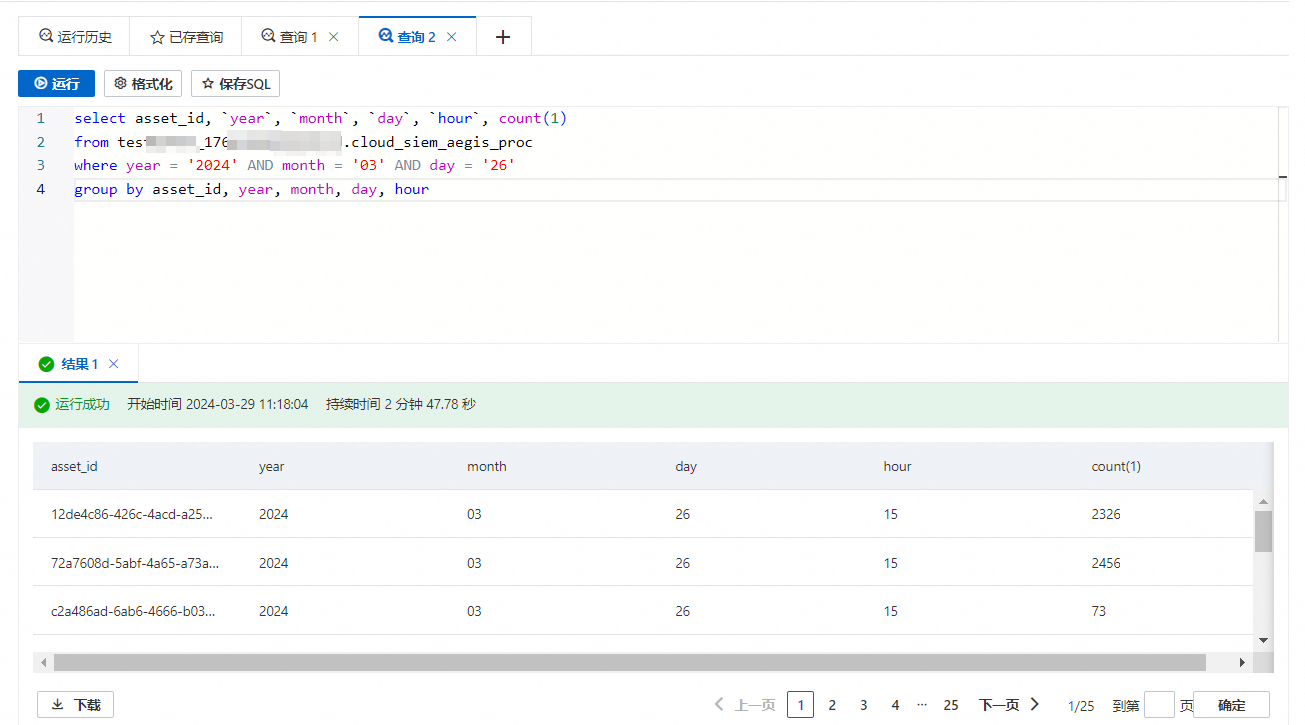

select asset_id, `year`, `month`, `day`, `hour`, count(1) from test****_17661858941*****.cloud_siem_aegis_proc where year = '2024' AND month = '03' AND day = '26' group by asset_id, year, month, day, hour查询结果如下:

在查询结果下方,单击下载,可下载查询结果的CSV文件。

最多支持下载1万条记录。

更多操作

修改日志存储天数

开启投递的云产品日志默认为永久保存,您可以根据需要修改存储天数。

修改存储天数后,存储时长已经超出存储天数的日志会被立即删除,请您谨慎设置存储天数。

在左侧导航栏,选择。

在产品接入页面右上角,单击日志存储管理。

在日志管理面板,修改冷数据的存储天数。

日志存储容量管理

您可以通过删除Bucket内文件的方式减少冷数据占用的存储空间。

在左侧导航栏,选择。

在产品接入页面右上角,单击日志存储管理。

在日志管理面板,单击前往OSS控制台清空容量。

在OSS控制台,删除不需要保存的日志文件。

具体操作,请参见删除文件。

相关文档

您可以通过控制台、Cloud Shell或命令行工具将热数据的日志或查询分析结果下载到本地。具体操作,请参见导出日志。

您也可以将热数据日志投递到OSS进行存储。具体操作,请参见创建OSS投递任务(新版)。

如果热数据日志存储空间被占满,将无法写入新的日志。您可以开启威胁分析与响应日志超量提醒通知,以便您及时扩容日志存储空间。具体操作,请参见通知设置。

您可以调用日志相关的API接口,搜索热数据日志。具体接口列表,请参见日志分析。

- 本页导读 (1)